MLOps 솔루션을 선택할 때 고려해야 할 주요 요소는 다음과 같습니다:

- 기존 도구 및 워크플로와의 통합: 선택한 MLOps 플랫폼이 현재 사용 중인 ML 스택(예: TensorFlow, PyTorch 등), CI/CD 파이프라인, 데이터 저장소와 원활하게 통합될 수 있어야 합니다.

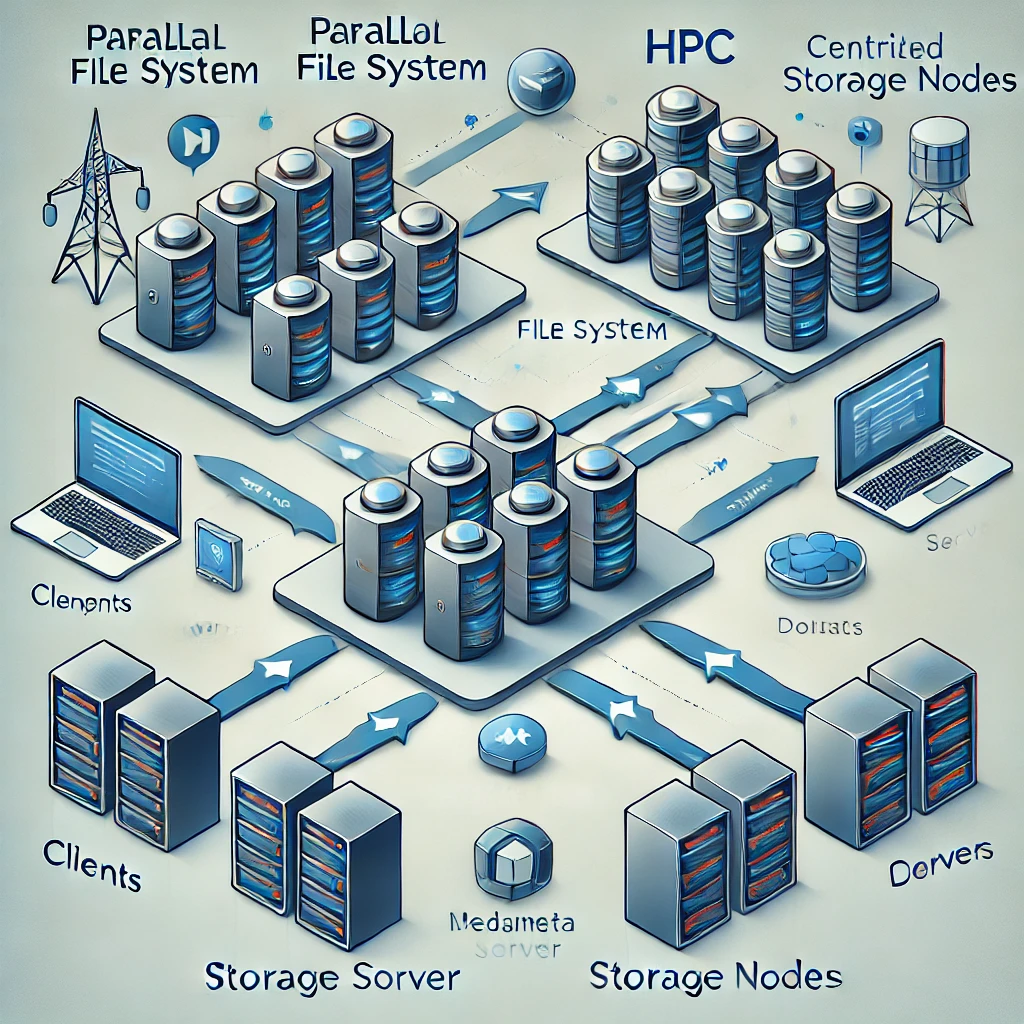

- 확장성: 데이터 처리 용량과 모델 수에 따라 확장할 수 있는지 확인해야 합니다. 대규모 데이터셋 처리, 높은 계산 요구사항, 여러 동시 모델 실행 등을 지원하는 확장성이 필요합니다.

- 자동화 및 파이프라인: 모델 학습, 검증, 배포, 모니터링 등의 반복 작업을 자동화할 수 있는 기능이 중요합니다. 자동 재학습, 모델 버전 관리 등을 지원하는 엔드투엔드 파이프라인이 필요합니다.

- 모니터링 및 거버넌스: 모델 성능, 드리프트, 규정 준수 등을 추적할 수 있는 모니터링, 알림, 로깅 기능이 필수적입니다. 감사 추적, 설명 가능성, 버전 관리 등 거버넌스 기능은 규제가 많은 산업에서 특히 중요합니다.

- 협업 및 재현성: 데이터 과학자, 엔지니어, 비즈니스 팀 간의 협업을 촉진하는 솔루션을 선택하세요. 실험 추적, 재현성, 버전 관리 기능은 팀 생산성을 크게 향상시킬 수 있습니다.

- 보안 및 규정 준수: 선택한 MLOps 플랫폼이 데이터 암호화, 접근 제어, 관련 규정(GDPR, HIPAA 등) 준수 등 조직의 보안 기준에 부합하는지 확인해야 합니다.

- 비용 및 ROI: 라이선스, 인프라, 유지 관리 등을 포함한 총 소유 비용을 고려하세요. 생산성 향상, 다운타임 감소, 모델 성능 개선 등의 ROI도 평가해야 합니다.

- 유연성과 맞춤화: 솔루션이 고유한 비즈니스 요구에 맞게 커스터마이징될 수 있어야 합니다. 맞춤형 코드 사용, 독점 도구 통합, 다양한 배포 환경(클라우드, 온프레미스, 하이브리드) 지원 등이 필요합니다.

- 사용 편의성 및 학습 곡선: 사용하기 쉬운 인터페이스와 잘 문서화된 기능이 사용자 채택에 중요합니다. 팀의 학습 곡선과 지원 및 교육 리소스의 가용성을 평가하세요.

- 벤더 지원 및 커뮤니티: 강력한 벤더 지원(SLA, 문서화, 커뮤니티 참여 등)은 문제를 신속히 해결하고 새로운 기능에 대한 최신 정보를 유지하는 데 큰 도움이 됩니다.

이러한 요소들을 고려하면 조직의 목표, 기술적 요구사항, 성장 가능성에 부합하는 MLOps 플랫폼을 선택할 수 있습니다.

MLOps 솔루션을 찾아보면, 데이터 준비, AI 모델 학습, 배포 및 관리 프로세스를 효율적으로 지원하는 다양한 솔루션이 있습니다. 이를 고려할 때 상용 및 오픈소스 솔루션에 대한 정보, 주요 특징, 데이터 흐름 관점에서의 적합성까지 이해하는 것이 중요합니다. 아래에 대표적인 솔루션들을 소개하고, 각 솔루션에 대한 세부 정보와 참고할 수 있는 웹사이트를 정리하였습니다.

1. Databricks / On-premise

- 유형: 상용 솔루션

- 주요 특징: Databricks는 데이터 준비, AI 학습, 배포에 이르는 엔드투엔드 파이프라인을 제공합니다. 특히 Apache Spark 기반의 대규모 데이터 처리, Delta Lake를 통한 데이터 레이크 관리, 그리고 MLflow를 활용한 모델 추적, 버전 관리 및 배포를 지원합니다.

- 적합성:

- 데이터 준비: Delta Lake 기반의 데이터 관리 및 처리가 강점.

- AI 학습: 대규모 데이터에 대한 병렬 학습 및 Hyperparameter Tuning 지원.

- 추론 및 배포: MLflow와 통합된 모델 서빙 및 모니터링 기능 제공.

- URL: https://databricks.com

2. Ray / On-premise

- 유형: 오픈소스 및 상용

- 주요 특징: Ray는 분산 컴퓨팅 프레임워크로, Python을 사용하여 분산 학습, 추론, 강화 학습 등을 간단히 구현할 수 있습니다. Ray는 ML 엔지니어링뿐만 아니라 대규모 Python 애플리케이션에도 적합하며, Ray Serve를 통해 모델 서빙도 지원합니다.

- 적합성:

- 데이터 준비: 분산 작업을 손쉽게 구성 가능.

- AI 학습: 대규모 분산 학습, 강화 학습 환경 지원.

- 추론 및 배포: Ray Serve를 통한 실시간 모델 추론 기능 제공.

- URL: https://www.ray.io

3. Palantir Foundry / On-premise & Appliance

- 유형: 상용 솔루션

- 주요 특징: Palantir Foundry는 주로 엔터프라이즈 수준에서 데이터 통합 및 분석을 위한 플랫폼으로 사용됩니다. 강력한 데이터 준비 및 모델 배포 기능을 제공하며, 특히 복잡한 데이터 파이프라인을 관리하고 다양한 데이터를 통합하여 실시간 분석 및 AI 모델 학습을 수행합니다.

- 적합성:

- 데이터 준비: 복잡한 데이터 통합 및 관리에 최적화.

- AI 학습: 통합된 분석 도구와 ML 파이프라인 제공.

- 추론 및 배포: 대규모 AI 모델 배포 및 실시간 모니터링 기능 제공.

- URL: https://www.palantir.com/foundry

4. MLDE, commercial Determined AI / On-premise & Embedded

- 개요: MLDE(Machine Learning Data Engineering)는 HPE AI 시스템에 탑재되어 제공되는 데이터 엔지니어링 및 MLOps 솔루션입니다. 주로 대규모 데이터 처리, AI 학습 파이프라인 구축, 그리고 모델 배포를 위한 통합 플랫폼으로 설계되었으며, GenAI 및 Model tuning 등을 효과적으로 진행하는 기능을 제공합니다.

- 주요 특징: 데이터 준비부터 모델 학습 및 배포까지 완전한 엔드투엔드 관리, 클라우드 및 온프레미스 지원, 엔터프라이즈 환경에서의 확장성 제공.

- 웹사이트: https://www.hpe.com

5. Kubeflow / On-premise

- 유형: 오픈소스 솔루션

- 주요 특징: Kubeflow는 Kubernetes 상에서 ML 워크플로우를 실행하기 위한 오픈소스 플랫폼입니다. 특히 Kubernetes 환경에서 파이프라인 구성 및 모델 서빙을 자동화하며, 다양한 데이터 준비 도구와 통합됩니다.

- 적합성:

- 데이터 준비: 다양한 데이터 준비 도구와 통합 가능.

- AI 학습: Kubernetes 클러스터에서 분산 학습 지원.

- 추론 및 배포: Kubernetes 기반의 확장성 있는 모델 배포 및 서빙.

- URL: https://www.kubeflow.org

6. MLflow / On-premise

- 유형: 오픈소스 솔루션

- 주요 특징: MLflow는 실험 추적, 모델 관리, 배포 및 파이프라인 구성을 지원하는 오픈소스 플랫폼입니다. 독립적으로 사용하거나 Databricks와 같은 솔루션과 통합하여 사용할 수 있습니다.

- 적합성:

- 데이터 준비: 주로 다른 도구와 통합하여 사용.

- AI 학습: 실험 추적 및 모델 버전 관리 지원.

- 추론 및 배포: 모델 서빙 및 배포 관리 도구 제공.

- URL: https://mlflow.org

7. Amazon SageMaker / Cloud

- 유형: 상용 솔루션 (AWS)

- 주요 특징: SageMaker는 AWS에서 제공하는 MLOps 서비스로, 데이터 준비, 학습, 배포까지의 전체 과정을 지원합니다. 특히 Jupyter Notebook과의 통합, 자동 하이퍼파라미터 튜닝, 모델 모니터링 등의 기능을 제공합니다.

- 적합성:

- 데이터 준비: AWS 데이터 서비스와의 강력한 통합.

- AI 학습: 분산 학습 및 자동화 기능.

- 추론 및 배포: 자동 확장 및 지속적인 배포 관리.

- URL: https://aws.amazon.com/sagemaker

8. Google Vertex AI / Cloud

- 유형: 상용 솔루션 (Google Cloud)

- 주요 특징: Vertex AI는 Google Cloud에서 제공하는 통합 AI 플랫폼으로, 데이터 준비, 모델 학습, 배포, 모니터링 등 모든 단계에 걸쳐 포괄적인 기능을 제공합니다. AutoML 및 커스텀 모델 모두 지원합니다.

- 적합성:

- 데이터 준비: BigQuery와 통합된 데이터 준비 기능.

- AI 학습: AutoML 및 커스텀 모델 학습 지원.

- 추론 및 배포: 실시간 서빙 및 대규모 배포 관리.

- URL: https://cloud.google.com/vertex-ai

9. Azure Machine Learning / Cloud

- 유형: 상용 솔루션 (Microsoft Azure)

- 주요 특징: Azure Machine Learning은 Microsoft의 MLOps 플랫폼으로, 데이터 준비, 학습, 배포, 모니터링 기능을 제공합니다. 자동화된 ML 파이프라인, 실험 관리, 모델 배포, 모니터링 도구를 통합 제공합니다.

- 적합성:

- 데이터 준비: Azure Data Factory와 통합된 데이터 준비.

- AI 학습: AutoML 및 대규모 학습 지원.

- 추론 및 배포: Kubernetes 기반의 확장성 있는 배포.

- URL: https://azure.microsoft.com/en-us/services/machine-learning

한국에서 개발된 주요 MLOps 솔루션

1. Gauss Labs / On-premise

- 개요: LG 그룹의 자회사인 Gauss Labs는 산업용 AI 솔루션을 제공하며, 제조 환경에 최적화된 MLOps 기능을 갖추고 있습니다. AI 모델 배포, 모니터링, 지속적 개선에 중점을 두고 스마트 팩토리 운영을 지원합니다.

- 주요 특징: 실시간 모니터링, 예측 유지보수 모델, 제조 공정과의 통합, 산업 AI를 위한 특화된 MLOps.

- 웹사이트: https://www.gausslabs.com

2. Naver Clova AI 플랫폼 / Cloud

- 개요: 네이버의 Clova AI 플랫폼은 데이터 준비부터 모델 배포 및 모니터링에 이르는 통합 AI 및 MLOps 서비스를 제공합니다. 대규모 자연어 처리와 컴퓨터 비전과 같은 AI 애플리케이션에 강점을 가지고 있습니다.

- 주요 특징: 엔드투엔드 AI 개발 도구, 네이버 생태계와의 통합, 소비자 및 기업 애플리케이션을 위한 확장 가능한 배포.

- 웹사이트: https://www.ncloud.com/product/aiService/clovaStudio

3. Kakao AIOps / Cloud

- 개요: 카카오 클라우드는 AI 연구와 상용화를 위한 AIOps 플랫폼을 제공합니다. 이 플랫폼은 자연어 처리(NLP), 컴퓨터 비전, 그리고 대규모 학습 모델을 위한 인프라와 함께 MLOps 기능을 지원합니다.

- 주요 특징: 대규모 AI 학습, 모델 배포 및 실시간 서비스 통합, AI 연구를 위한 데이터 인프라 제공.

- 웹사이트: https://kakaobrain.com

4. Lablup Backend.AI / On-premise

- 개요: Lablup의 Backend.AI는 한국의 오픈소스 기반 MLOps 플랫폼으로, AI 학습 및 인프라 관리를 지원합니다. GPU 및 기타 하드웨어 자원의 효율적 활용을 위해 설계되었으며, 데이터 사이언스 및 연구 개발에 적합합니다. 타 솔루션 대비 높은 비용은 고려점 중 하나입니다.

- 주요 특징: 클라우드 및 온프레미스에서의 유연한 배포, 자동 자원 관리, 멀티유저 환경 지원.

- 웹사이트: https://www.lablup.com

사용자가 사용하는 MLOps/AIOps 솔루션의 경우, 사용성에 익숙해지고 나면 향후 변경하기가 매우 어려운 특성을 가지고 있습니다.

따라서 초기의 솔루션 선택이 매우 중요한데, 조직의 요구사항에 맞는 MLOps 솔루션을 선택하는 경우, 이 정보들을 바탕으로 기능 및 비용, 향후 로드맵 등을 다양하게 고려해야 합니다.

현명한 선택을 위한 고려사항 / 적정비용 등

MLOps 솔루션의 적절한 가격을 결정하려면 비용이 조직에 제공하는 가치와 일치하도록 여러 요소를 평가해야 합니다. 다음은 MLOps 솔루션 가격 책정에 대한 구조적 접근 방식입니다.

1. 가격 모델

- 구독 기반 가격: SaaS 플랫폼에서 일반적으로 사용됩니다. 가격은 사용 수준, 기능 또는 사용자 수에 따라 계층화됩니다.

따라서 관공서 및 공공 부문 또는 일부 기업등에서는 반드시 ‘Permanent License + Support’ 형태의 라이센스 정책을 보유한 솔루션을 선택해야 합니다. Subscription 형태의 라이센스 기반 솔루션은 매년 초기도입비용을 지속적으로 지급해야 하므로 TCO 부문에서 급격한 비용낭비를 가져옵니다. - 사용량 또는 사용자 기반 가격: 처리한 데이터 양, 모델 수 또는 사용한 컴퓨팅 시간에 따라 요금이 부과됩니다.

일부 솔루션은 사용자 또는 사용 자원의 크기에 따라 부과되는 라이센스 정책을 지닙니다.

개발 및 기능테스트를 위한 소규모 시스템의 경우 보다 합리적인 접근이 가능합니다. - 맞춤형 엔터프라이즈 가격: 복잡한 요구 사항을 가진 대기업의 경우, MLOps 공급업체가 특정 요구 사항에 따라 맞춤형 가격을 제공합니다.

2. 고려해야 할 주요 요소

- 목표 기능 확정: 현재 AI 시장의 MLOps 솔루션들은 개발(사용자)을 위한 기능과 인프라(운영자)를 위한 기능을 혼재해서 탑재한 경우가 대부분입니다.

인프라 관리 및 운영을 위한 솔루션은 매우 비용이 낮고, 제조사에 따라 기본 제공되는 경우가 대부분이므로 가급적 MLOps는 인프라(GPU/시스템/네트워크 등) 관리를 위한 기능이 제외된 순수 AI 모델개발자를 위한 다양한 기능이 탑재된 솔루션으로 국한하여 결정하는 것이 바람직합니다.

기능 기준으로 솔루션을 선정하면 보다 명확하게 각 제품을 평가할 수 있고 획기적으로 도입 및 운영 라이센스 비용이 절감됩니다. - 확장성 및 유연성: 사용량에 따라 가격이 어떻게 조정되는지 확인해야 합니다. 솔루션은 필요에 따라 비용이 급격히 증가하지 않고 유연한 계획을 제공해야 합니다.

- 기능 세트 및 맞춤화: 자동화된 파이프라인, 모델 모니터링, 맞춤형 통합과 같은 고급 기능이 필요한 경우, 높은 가격이 정당화될 수 있습니다.

- 배포 환경: 온프레미스 솔루션은 초기 비용이 높을 수 있지만, 클라우드 기반 MLOps는 초기 비용이 낮고 유연한 대신 지속적인 비용이 발생합니다.

- 지원 및 SLA: 엔터프라이즈급 지원, 빠른 응답 시간, 전담 계정 관리를 제공하는 경우 비용이 증가할 수 있습니다.

- 전환 비용: 플랫폼이 미래에 확장되지 않거나 요구 사항을 충족하지 않는 경우, 다른 솔루션으로 전환하는 비용을 고려해야 합니다.

3. 주요 공급업체의 가격 예시

- Databricks: 구독 및 사용량 기반 가격 모델을 따르며, 기능 및 워크로드에 따라 계층화된 구조를 가지고 있습니다. 엔터프라이즈 고객에게는 맞춤형 가격을 제공합니다.

- Kubeflow: 오픈소스 플랫폼으로 자체적으로는 무료지만, 인프라, 통합, 유지보수 비용이 발생합니다.

- Ray (Anyscale): 오픈소스와 관리형 솔루션을 모두 제공하며, 클라우드 인프라 사용량이나 지원 서비스에 따라 가격이 책정됩니다.

- Naver Clova, Kakao Brain: 이러한 대규모 조직은 AI 플랫폼을 더 넓은 엔터프라이즈 솔루션의 일환으로 제공하며, 가격은 사용량과 엔터프라이즈 계약에 따라 맞춤화됩니다.

- Embed 또는 오픈소스: 일부 시스템과 함께 제공되는 MLOps 솔루션들과 오픈소스 기반 소프트웨어들은 도입비용 부담이 없으나 예상 외로 훌륭한 기능을 제공하므로 향후 개발로드맵 및 목표기능 등이 정리되기 전까지 이러한 솔루션들을 적극 활용하는 것을 추천합니다.

4. 비용과 가치의 균형

- 총 소유 비용(TCO): 소프트웨어 라이선스, 클라우드 인프라, 인력, 유지보수를 포함한 전체 비용을 평가하세요. 효율적인 MLOps 플랫폼은 수작업 감소와 운영 리스크 감소로 인해 더 높은 비용을 정당화할 수 있습니다.

- 투자 수익률(ROI): MLOps 플랫폼이 모델 배포 속도를 얼마나 개선하고, 오류를 줄이며, 확장성을 향상시키고, 궁극적으로 수익에 미치는 영향 측정이 중요합니다.

- 성장에 따른 요금제(Pay-as-You-Grow): 작게 시작하고 MLOps 운영이 확장됨에 따라 비용을 효율적으로 조정할 수 있는 가격 구조를 찾아야 합니다.

5. 엔터프라이즈 솔루션을 위한 협상 팁

- 파일럿 프로그램 요청: 플랫폼의 적합성을 평가하기 위해 파일럿 프로그램을 요청하는 것을 권합니다.

- 서비스 번들: 공급업체가 관련 서비스를 함께 제공하는 경우, 번들 구매를 통해 비용 절감이 가능할 수 있습니다.

- 유연한 계약: 실제 요구 사항에 따라 사용량을 조정할 수 있는 유연한 계약 협상타진이 가능하므로 상용솔루션의 경우 해당 영업팀과 반드시 상의해야 합니다.

적절한 가격 전략은 MLOps 플랫폼이 조직에 제공하는 효율성과 가치를 평가하는 데 있습니다. 여러 공급업체를 비교하고, 특정 요구 사항을 평가하며, 미래 성장에 대한 전망을 통해 최적의 가격 솔루션을 찾을 수 있습니다.